Ein X-MASMR von Dr. Sound

Du bist noch nicht in Weihnachtsstimmung? Dann hör‘ dir hier das X-MASMR Oh Tannenbaum von Dr. Sound an: ein Roleplay-ASMR in dem DU der Tannenbaum🎄 bist, der weihnachtlich geschmückt wird, und in dem es auf und unter deiner ›Tannenbaum-Haut‹ kribbelt. Dabei erfährst du, dass auch Tannenbäume empfindsam sind😉. Darum: lasst die Tannenbäume da in der Erde stehen, wo sie stehen, z.B. im Wald, und schmückt und ehrt sie dort🌲🌲🎄🌲🌲

Mit diesem soundpraktischen Weihnachts-Special☃️ wünsche ich viel Fröhlichkeit allerseits, verabschiede mich von euch für dieses Jahr 2025, und freue mich auf viiieeeeeel Sound-Spaß🤩 zusammen mit euch im neuen Jahr🥳🔊

Studio-Produktion

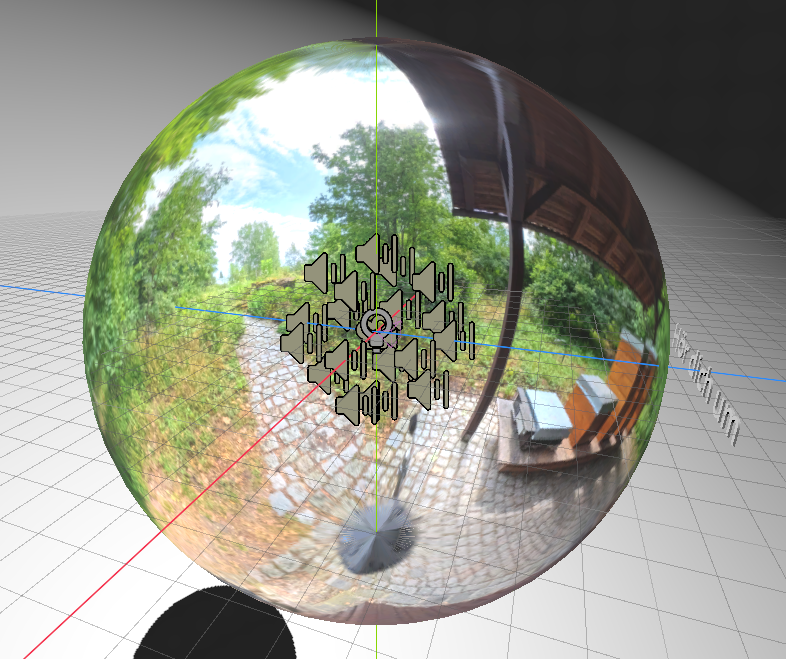

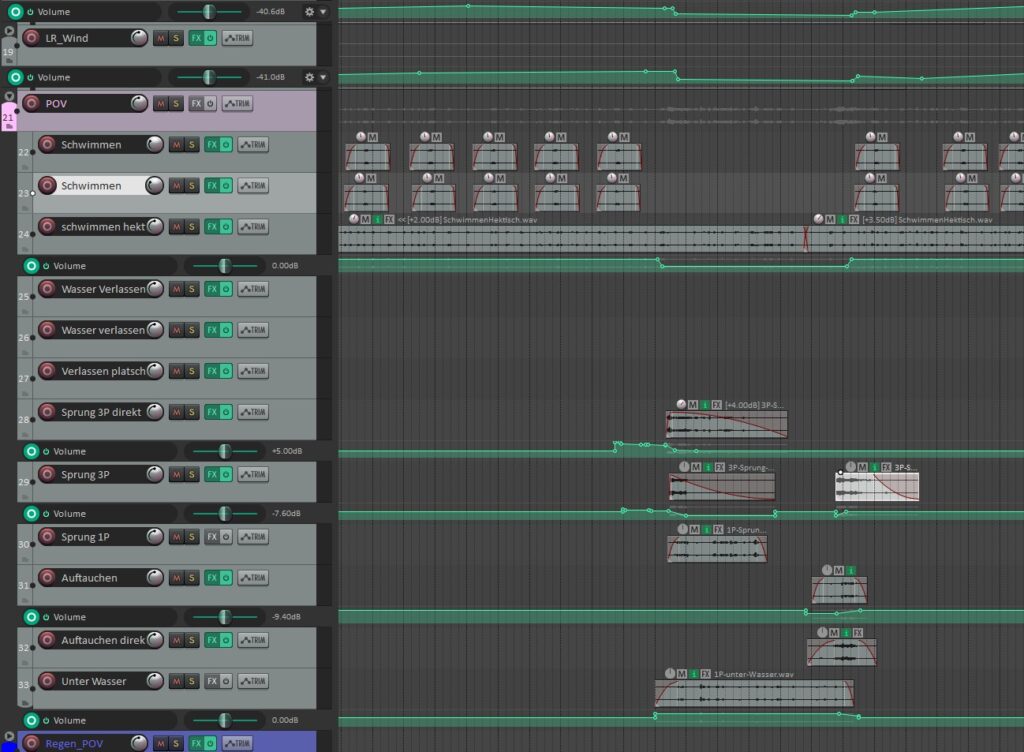

Mir ging es bei dieser Produktion darum, einmal ein ASMR nicht zu performen, sondern im Studio zu produzieren, von der Aufnahme über das Schneiden bis hin zur Verräumlichung im 360° Klangfeld. Und es ging mir dabei darum, zu erleben, wie ASMR als Hörspiel gedacht viel Kreativität freisetzen kann. Von daher: Macht doch einfach ein ASMR-Medienprojekt🤩, es macht so viel Spaß😃!

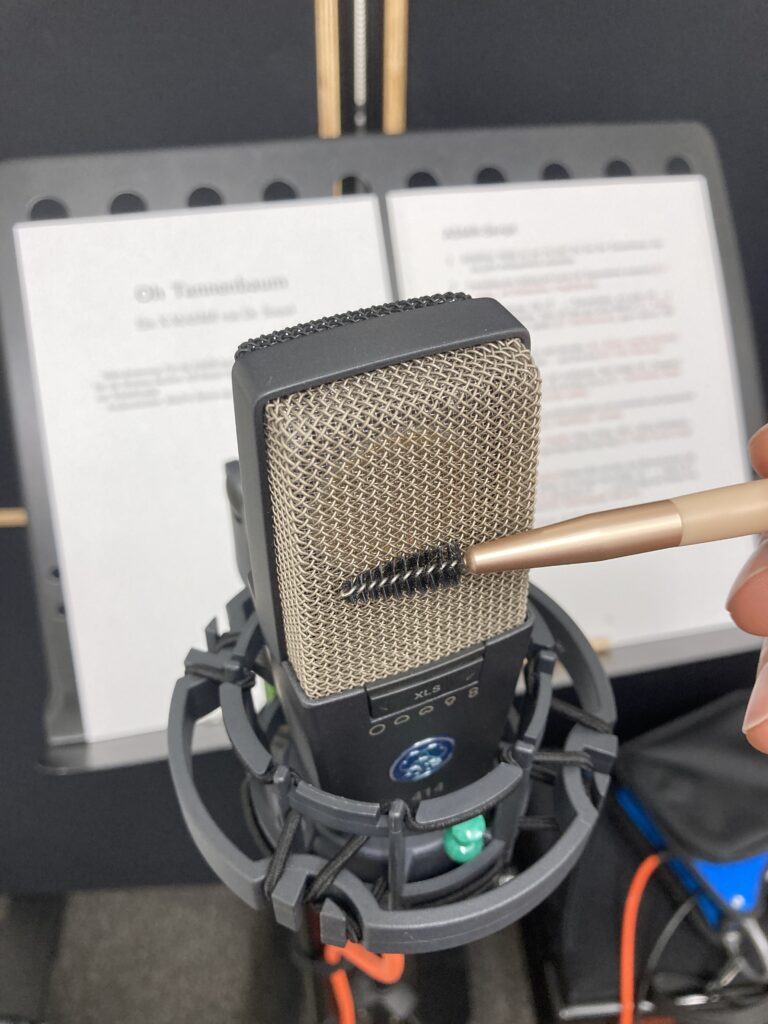

Dieses Roleplay-ASMR habe ich in 3D-Audio (Ambisonics 1st Order) produziert🤓, d.h. ich habe im Studio die Stimme (Text und Mouth-Sounds) und die SoundFX in Mono aufgenommen (mit einem AKG C414 mit der Richtcharakteristik Hyperniere) und in der Postproduktion in einem 360° Klangfeld verräumlicht, das hier als binaurales Stereo (funktioniert nur mit Kopfhörern!) gehört werden kann – oder im Klangdom👍.

Aufnahme-Setup

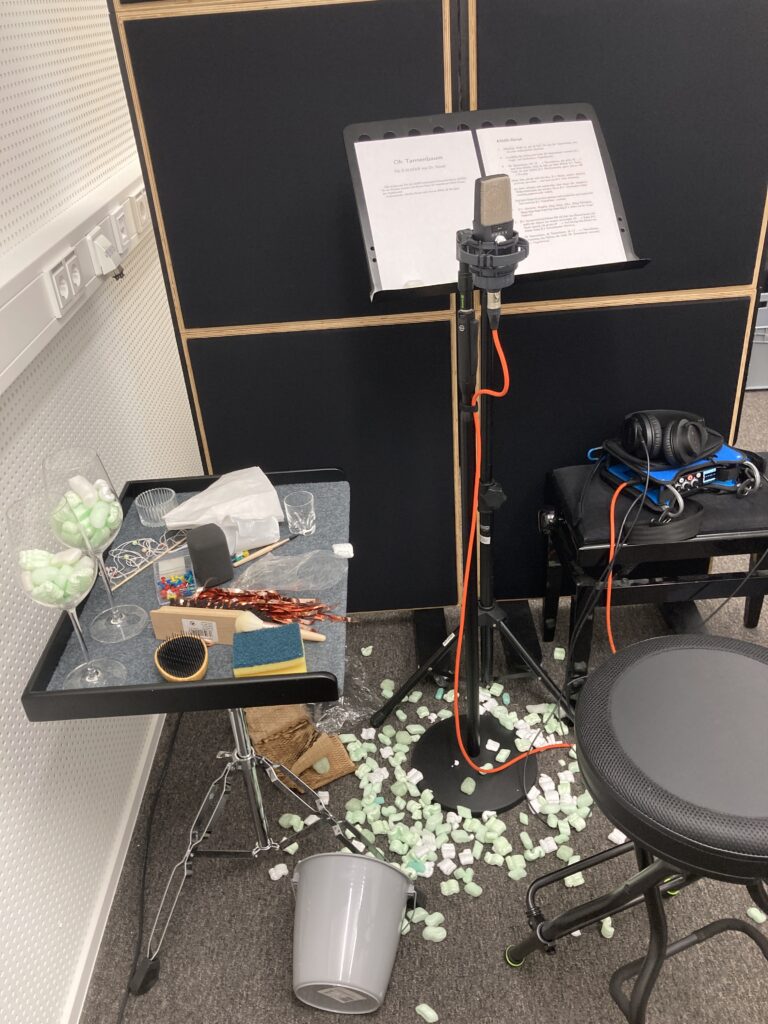

Aufgenommen habe ich in 32 Bit Float auf einem MixPre 3 II von SoundDevices, da ich nicht ständig den Eingangspegel regeln wollte und es beim ASMR sowieso unvorherhörbare Lautstärken gibt – kein Problem mit der neuen Aufnahmetechnologie.

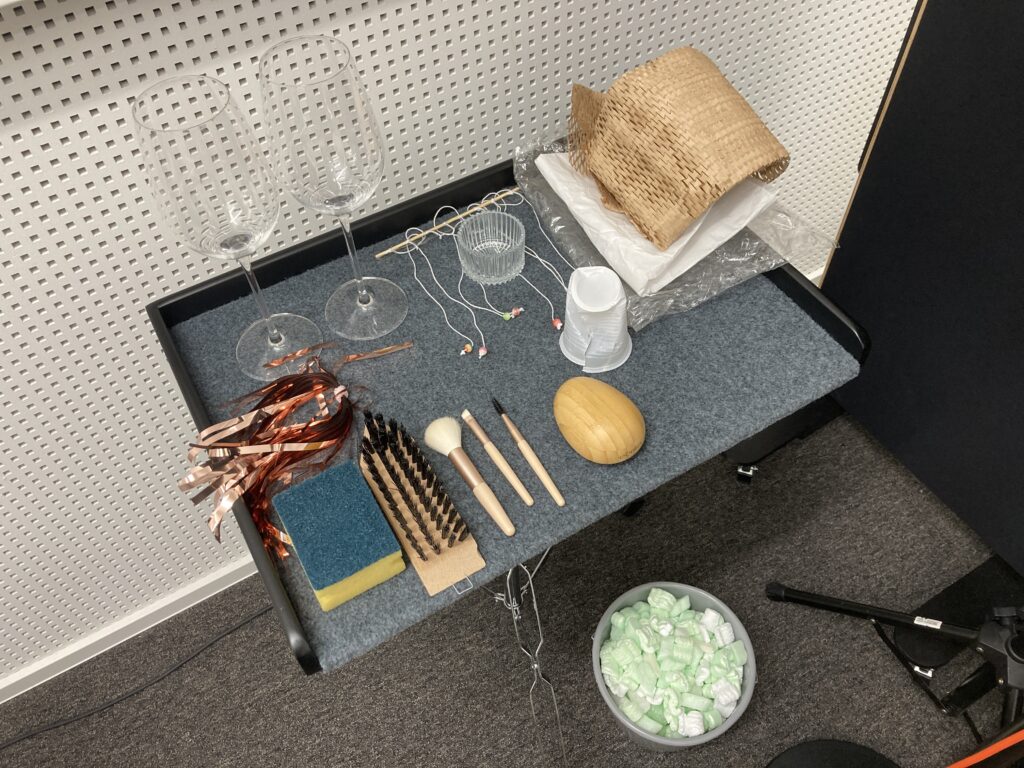

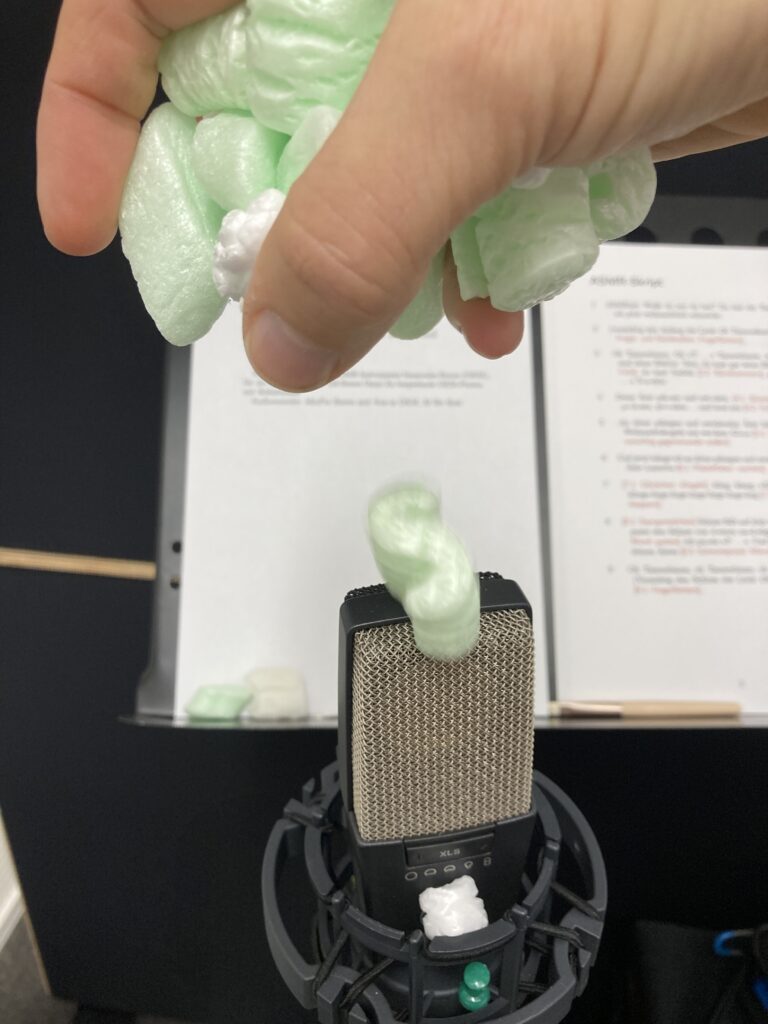

Hier seht ihr das Setup im Studio vor und nach der Aufnahme-Session: ich war voll im Flow, wie zu sehen.

ASMR-Instrumente